Có thể bạn đã quen thuộc với deepfakes , “phương tiện tổng hợp” được thay đổi kỹ thuật số có khả năng đánh lừa mọi người nhìn hoặc nghe những điều chưa bao giờ thực sự xảy ra. Các ví dụ đối nghịch giống như các trò chơi sâu cho các hệ thống AI nhận dạng hình ảnh – và mặc dù trông chúng thậm chí không hơi xa lạ đối với chúng ta, nhưng chúng có khả năng khiến máy móc kinh ngạc.

Cách đây vài năm , các nhà nghiên cứu tại Phòng thí nghiệm Khoa học Máy tính và Trí tuệ Nhân tạo của Viện Công nghệ Massachusetts (CSAIL) đã phát hiện ra rằng họ có thể đánh lừa các thuật toán nhận dạng hình ảnh tinh vi thành những vật thể khó hiểu chỉ bằng cách thay đổi một chút kết cấu bề mặt của chúng. Đây cũng không phải là những pha trộn nhỏ.

Trong cuộc trình diễn của các nhà nghiên cứu, họ cho thấy rằng có thể có được một mạng lưới thần kinh tiên tiến để nhìn vào một con rùa in 3D và thay vào đó là một khẩu súng trường. Hoặc nhìn vào một quả bóng chày và đi đến kết luận rằng đó là cà phê espresso.

Các ví dụ về đối thủ thể hiện một lỗ hổng hấp dẫn khi nói đến cách các hệ thống AI trực quan nhìn thế giới. Nhưng chúng cũng như bạn có thể mong đợi từ một lỗ hổng làm nhầm lẫn một con rùa đồ chơi mới với một khẩu súng trường, là một điều đáng báo động. Đó là một trong những vấn đề mà các nhà nghiên cứu đang tìm cách vá trong tuyệt vọng.

Giờ đây, một nhóm các nhà nghiên cứu khác từ MIT đã đưa ra một hệ thống mới có thể giúp tránh các đầu vào “đối nghịch”. Trong quá trình này, họ đã tưởng tượng ra một trường hợp sử dụng thực sự đáng sợ cho các ví dụ đối nghịch, một trường hợp có thể, nếu được thực hiện bởi tin tặc, sẽ được sử dụng để gây hiệu ứng chết người.

Kịch bản là: Xe ô tô tự hành ngày càng tốt hơn trong việc nhận thức thế giới xung quanh. Nhưng điều gì sẽ xảy ra nếu đột nhiên, các camera tích hợp dựa trên đầu vào trực quan trong ô tô bị cố ý hoặc vô tình kết xuất không thể xác định những gì đang ở phía trước của họ? Việc phân loại sai một đối tượng trên đường – chẳng hạn như không xác định chính xác và đặt người đi bộ – có thể thực sự rất rất tồi tệ.

Chống lại các cuộc tấn công của đối thủ

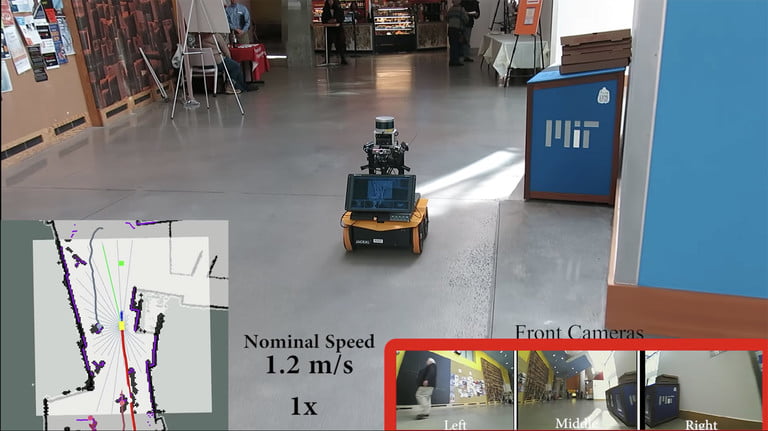

“Nhóm của chúng tôi đã làm việc tại giao diện của học sâu, người máy và lý thuyết điều khiển trong vài năm – bao gồm cả nghiên cứu về việc sử dụng RL sâu [học tăng cường] để huấn luyện robot điều hướng theo cách có ý thức xã hội xung quanh người đi bộ,” Michael Everett , một nhà nghiên cứu sau tiến sĩ tại Khoa Hàng không và Du hành vũ trụ MIT, nói với Digital Trends. “Khi chúng tôi đang suy nghĩ về việc làm thế nào để đưa những ý tưởng đó lên các phương tiện lớn hơn và nhanh hơn, các câu hỏi về độ an toàn và độ bền trở thành thách thức lớn nhất. Chúng tôi đã nhìn thấy cơ hội tuyệt vời để nghiên cứu vấn đề này trong học tập sâu từ quan điểm kiểm soát mạnh mẽ và tối ưu hóa mạnh mẽ. ”

Học tăng cường là một cách tiếp cận dựa trên thử-và-sai đối với học máy, nổi tiếng, đã được các nhà nghiên cứu sử dụng để khiến máy tính học cách chơi trò chơi điện tử mà không cần được dạy cách rõ ràng. Thuật toán dựa trên mạng nơ-ron sâu và học tập củng cố mới của nhóm được gọi là CARRL, viết tắt của Certified Adversarial Robustness for Deep Reinforcement Learning. Về bản chất, đó là một mạng lưới thần kinh với một lượng hoài nghi tăng thêm khi nói đến những gì nó đang nhìn thấy.

Trong một lần trình diễn công việc của họ, được hỗ trợ bởi Ford Motor Company, các nhà nghiên cứu đã xây dựng một thuật toán học tăng cường có thể chơi trò chơi Atari cổ điển Pong . Tuy nhiên, không giống như những người chơi trò chơi RL trước đó, trong phiên bản của họ, họ đã áp dụng một cuộc tấn công đối nghịch khiến tác nhân AI đánh giá vị trí bóng của trò chơi, khiến người chơi nghĩ rằng nó thấp hơn một vài pixel so với thực tế. Thông thường, điều này sẽ khiến người chơi AI gặp bất lợi lớn, khiến nó liên tục thua đối thủ máy tính. Tuy nhiên, trong trường hợp này, tác nhân RL nghĩ về tất cả các vị trí mà quả bóng có thể ở, và sau đó đặt mái chèo vào nơi nào đó mà nó sẽ không bị trượt bất kể sự thay đổi vị trí.

“Loại thuật toán học sâu mạnh mẽ mới này sẽ là yếu tố cần thiết để đưa các kỹ thuật AI đầy hứa hẹn vào thế giới thực.”

Tất nhiên, trò chơi được đơn giản hóa hơn rất nhiều so với thế giới thực, như Everett thừa nhận.

“Thế giới thực có nhiều sự không chắc chắn hơn so với trò chơi điện tử, từ các cảm biến không hoàn hảo hoặc các cuộc tấn công của đối thủ, có thể đủ để đánh lừa các hệ thống học sâu đưa ra các quyết định nguy hiểm – [chẳng hạn như] phun sơn một chấm trên đường [có thể gây ra xe tự lái] để rẽ sang làn đường khác, ”anh ta giải thích. “Công việc của chúng tôi trình bày một thuật toán RL sâu, có thể chứng nhận là mạnh mẽ đối với các phép đo không hoàn hảo. Sự đổi mới quan trọng là, thay vì tin tưởng một cách mù quáng vào các phép đo của nó, như được thực hiện ngày nay, thuật toán của chúng tôi suy nghĩ thông qua tất cả các phép đo có thể đã được thực hiện và đưa ra quyết định xem xét kết quả trong trường hợp xấu nhất. ”

Trong một minh chứng khác, họ cho thấy rằng thuật toán có thể, trong bối cảnh lái xe mô phỏng, có thể tránh va chạm ngay cả khi các cảm biến của nó đang bị tấn công bởi kẻ thù muốn tác nhân va chạm. Everett nói: “Loại thuật toán học sâu mạnh mẽ mới này sẽ là yếu tố cần thiết để đưa các kỹ thuật AI đầy hứa hẹn vào thế giới thực.

Còn nhiều việc phải làm

Vẫn còn là những ngày đầu cho công việc này và còn nhiều việc cần phải làm. Ngoài ra còn có một vấn đề tiềm ẩn mà trong một số trường hợp, điều này có thể khiến tác nhân AI hoạt động quá thận trọng, do đó làm cho nó hoạt động kém hiệu quả hơn. Tuy nhiên, đó là một phần nghiên cứu có giá trị có thể có những tác động sâu sắc trong tương lai.

“[Có những dự án nghiên cứu khác] tập trung vào việc bảo vệ chống lại [một số loại] ví dụ đối nghịch, trong đó công việc của mạng nơ-ron là phân loại một hình ảnh và nó đúng [hoặc] sai, và câu chuyện kết thúc ở đó,” Everett nói, khi được hỏi về vấn đề súng trường đấu rùa cổ điển. “Công việc của chúng tôi được xây dựng dựa trên một số ý tưởng đó, nhưng tập trung vào việc học tập củng cố, nơi người đại diện phải thực hiện các hành động và nhận được một số phần thưởng nếu nó làm tốt. Vì vậy, chúng tôi đang xem xét một câu hỏi dài hạn hơn là ‘Nếu tôi nói đây là một con rùa, thì ý nghĩa tương lai của quyết định đó là gì?’ và đó là nơi thuật toán của chúng tôi thực sự có thể giúp ích. Thuật toán của chúng tôi sẽ suy nghĩ về các tác động trong tương lai trong trường hợp xấu nhất của việc chọn một con rùa hoặc một khẩu súng trường, đây có thể là một bước quan trọng để giải quyết các vấn đề bảo mật quan trọng khi quyết định của các tác nhân AI có ảnh hưởng lâu dài. ”

Một bài báo mô tả nghiên cứu có sẵn để đọc trên kho lưu trữ bản in trước điện tử arXiv .

Thứ gì cản trở bạn hành động theo điều bạn biết chắc chắn đúng? Các yếu tố nào chi phối việc hành động bền bỉ? Để hiểu được các nguyên nhân cản trở xung quanh và loại bỏ các chướng ngại cần sự dũng cảm. Trong đó, nhận thức sẽ đi đầu tiên. Tiếp theo nhận thức, cần có các công cụ hỗ trợ để duy trì và tối ưu trong các giải pháp. Tổ tiên loài người ngày xưa cùng các nhà khoa học hiện nay đã miệt mài nghiên cứu. Bạn sẽ được thừa hưởng các tinh hoa và mượn sức thành tựu và xây tiếp bức tranh mà bạn muốn trở thành. Tất cả nằm trong khóa học PHƯƠNG PHÁP LUẬN SÁNG TẠO và ĐỔI MỚI tại Trung tâm Sáng tạo Khoa học–kỹ thuật (TSK) thuộc trường Khoa Học Tự Nhiên. Đăng ký ngay tại đây hoặc liên hệ số điện thoại: (028) 38 301 743/ 089 668 36 31. Chào đón bạn!

Nguồn: DigitalTrends